**导读:**如果你经常需要按关键词批量下载图片,或者想把“搜图—下载—去重—发送”做成自动化流程,那么 image-downloader 这个 Skill 值得关注。它不是单纯的图片下载脚本,而是一个可以接入 OpenClaw / ClaudeCode 工作流的能力组件。本文会从项目链接、核心能力、使用方式、运行效果和自动化场景几个维度,介绍这个 Skill 的实际价值与适用方式。

项目相关链接

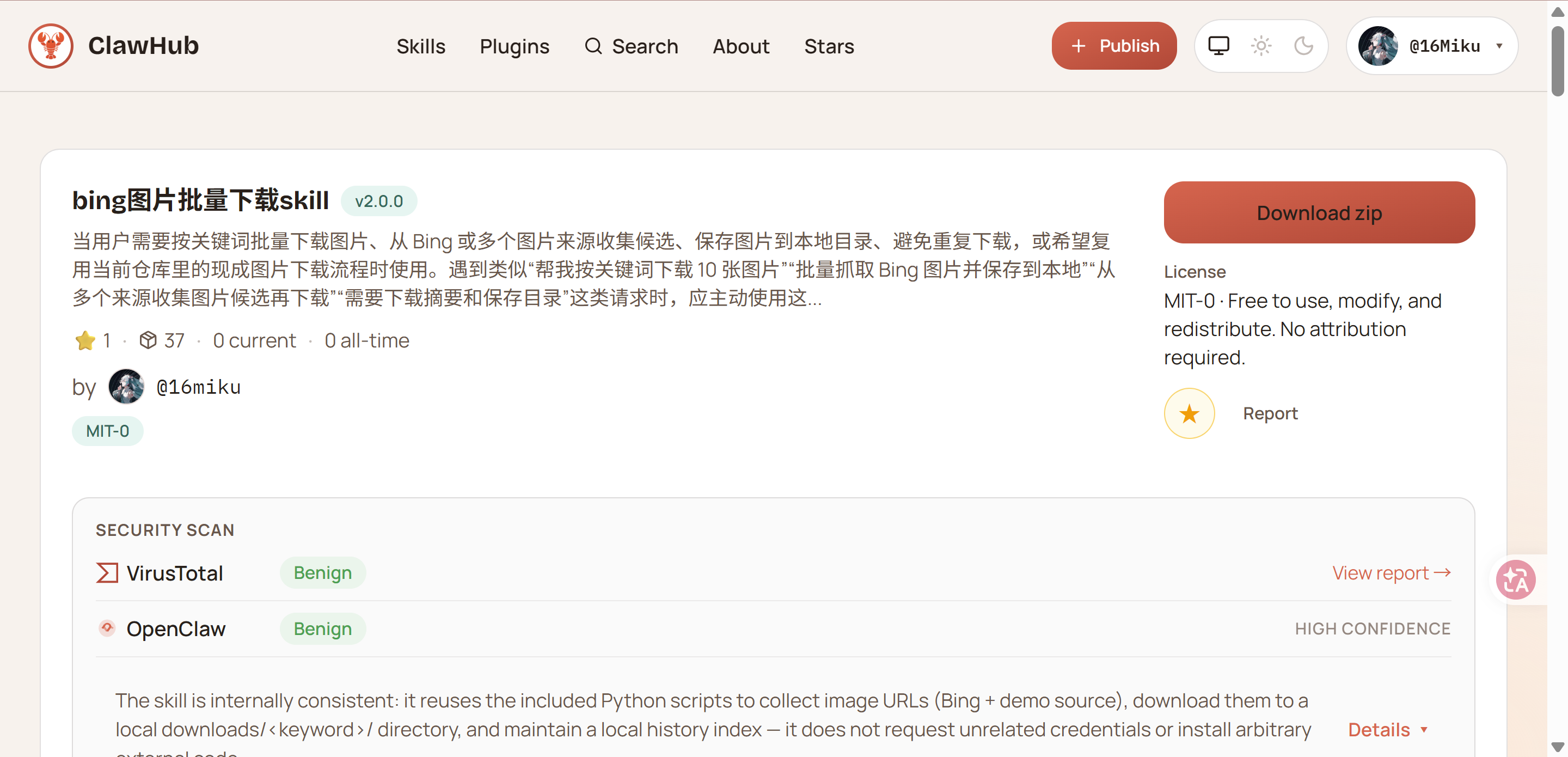

+ClawHub 页面:https://clawhub.ai/16miku/image-downloader

+GitHub 仓库:https://github.com/16Miku/image-downloader-skill

+Skill 名称:image-downloader

+适用平台:OpenClaw / ClaudeCode

一、为什么我要写这个 Skill?

在很多实际场景里,我们都会遇到一个很高频但又很琐碎的需求:

- 想按关键词批量下载图片

- 想快速收集公开图片素材

- 想要一个可以复用的下载流程,而不是每次临时写脚本

- 想尽量减少重复下载,拿到清晰的下载结果摘要

如果只是偶尔下载几张图片,手动保存当然也可以;但一旦进入批量下载、持续下载、定时下载、自动发送这样的工作流,手工方式就会迅速变得低效。

image-downloader 这个 skill,正是为了解决这个问题而设计的。

它不是一个“全网万能爬虫”,而是一个专注于关键词搜图与批量下载流程复用的技能组件:

- 输入关键词

- 收集 Bing 等来源的候选图片

- 自动去重

- 逐张下载到本地目录

- 记录下载元数据

- 方便下一轮继续跳过历史重复内容

对于需要做素材收集、内容运营、自动化图文工作流的人来说,这个 skill 非常实用。

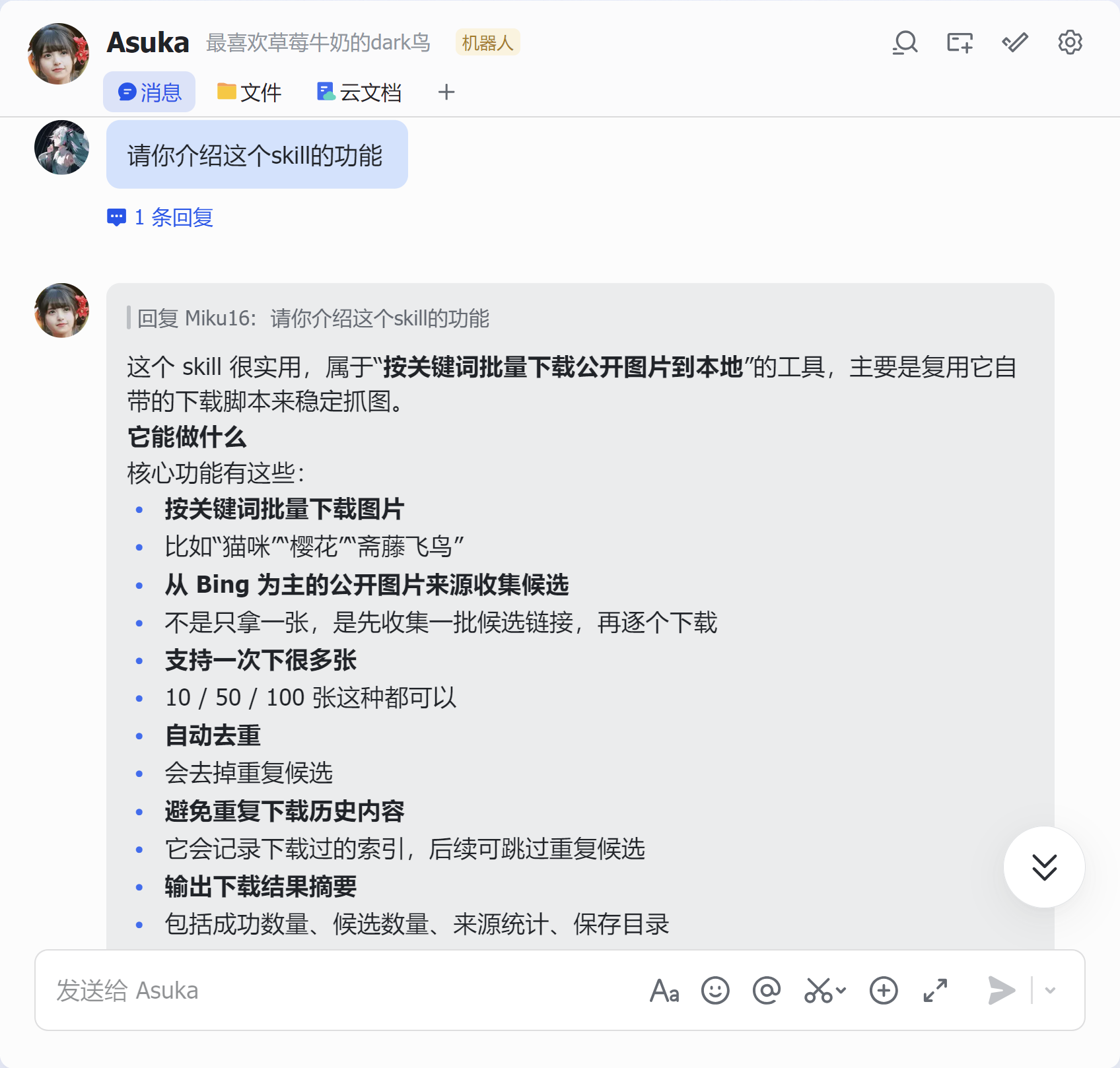

二、Skill 的核心能力

1. 按关键词批量下载公开图片

最核心的能力,就是按关键词抓取图片并保存到本地。

比如:

- 下载 10 张猫咪图片

- 下载 20 张斋藤飞鸟美图

- 下载某位偶像、演员、产品、景点的素材图

你只需要给出关键词和数量,skill 就能完成从候选收集到实际下载的完整流程。

2. 支持扩充候选池,提高成功率

在真实网络环境里,并不是每一个搜索结果里的原图链接都能顺利访问。

常见问题包括:

403 Forbidden- SSL 证书异常

- 原图链接失效

- 源站超时

- 图片服务拒绝非浏览器访问

因此,这个 skill 的思路不是“赌每一条链接都成功”,而是:**尽可能多收集候选,再从中补位下载,最终提高成功数量。**这也是为什么当目标数量变大时,通常需要提高抓取页数(--pages)。

3. 自动去重,避免重复候选

批量搜图时,一个很烦人的问题就是:

- 同一张图片在不同页面重复出现

- 不同搜索词搜到大量重叠结果

- 重新执行任务时,又下到了之前已经下载过的内容

这个 skill 内置了去重和历史索引记录能力,可以有效减少重复下载。

4. 输出清晰的运行摘要

每次执行结束后,skill 都会输出一份很适合汇报结果的摘要,包括:

- 关键词

- 目标下载数

- 候选总数

- 去重后数量

- 实际成功下载数量

- 跳过数量

- 来源统计

- 保存目录

这对于后续接入自动化通知、日报、定时任务,都非常有帮助。

三、这个 Skill 适合哪些场景?

内容运营 / 自媒体素材收集

当你在写文章、做账号运营、整理专题内容时,经常需要按主题批量找图。这个 skill 可以直接作为素材采集环节使用。

AI Agent 自动化流程

它特别适合接入到 Agent 工作流中,例如:

- 每天定时下载某个主题的新图片

- 下载后自动发送到飞书 / Telegram / Discord

- 为文章生成配图候选素材池

- 为知识库或云文档补充演示图片

批量图像采集任务

如果你有“按关键词下载 20 / 50 / 100 张图片”的需求,这个 skill 也比手动操作高效得多。

四、它和普通下载脚本有什么区别?

很多人第一反应可能是:

“这不就是一个图片下载脚本吗?”

但从 Agent 技能的角度看,它的价值不只是“能下载”,而是能被稳定复用到工作流****里。

普通脚本的常见问题

- 只能临时在本地执行

- 参数约定不统一

- 没有面向 Agent 的调用说明

- 不方便接入定时任务与消息通知

- 结果缺少结构化摘要

这个 Skill 的优势

- 有清晰的SKILL.md使用规范

- 可直接被 Agent 识别并调用

- 自带推荐参数策略

- 强调“候选池 + 去重 + 补位”的下载思路

- 天然适合作为自动化工作流的一部分

换句话说,它不是单纯给人手工点点点用的,而是给智能体协作、自动化执行和连续任务用的。

五、使用方式

1. 基础命令示例

下载 10 张图片:

uv run --with requests python "scripts/bing_image_downloader.py" "cat" --limit 10 --pages 3下载 50 张图片:

uv run --with requests python "scripts/bing_image_downloader.py" "cat" --limit 50 --pages 5下载 100 张图片:

uv run --with requests python "scripts/bing_image_downloader.py" "cat" --limit 100 --pages 102. 参数说明

| 参数 | 说明 | 示例 |

|---|---|---|

keyword | 搜索关键词 | 齋藤飛鳥 |

--limit | 希望下载的图片数量 | 20 |

--pages | 抓取结果页数 | 4 / 6 / 10 |

3. 推荐经验值

- 下载10 张:建议

--pages 3 - 下载20 张:建议

--pages 4~6 - 下载50 张:建议

--pages 5 - 下载100 张:建议

--pages 10

如果你发现下载成功率偏低,优先不是改并发,而是先扩大候选池。

六、运行结果长什么样?

一次典型执行后,通常会得到类似这样的结果:

关键词: 齋藤飛鳥

目标下载数: 20

候选总数: 32

去重后数量: 32

实际成功下载: 20

跳过重复: 0

来源统计:

- bing: 20

- demo: 12

保存目录: downloads/齋藤飛鳥从这份输出里,你可以非常直观地看到:

- 候选池够不够大

- 下载是否达标

- 是否有大量重复

- 图片最后保存到了哪里

这类结果特别适合进一步接到:

- 飞书消息通知

- 自动日报

- 云文档汇总

- 定时任务回传

七、基于OpenClaw演示

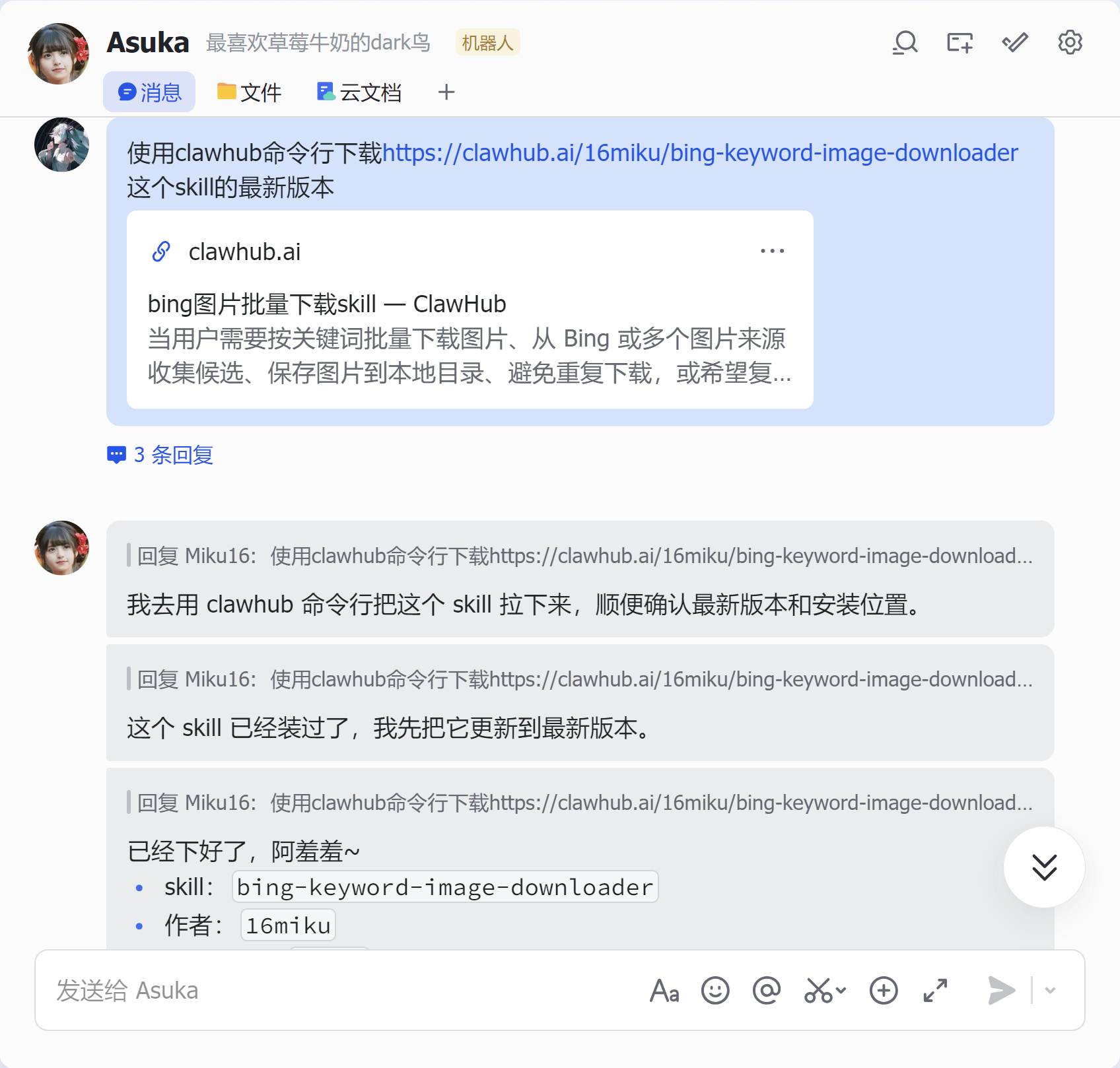

1. 安装Skill

在 ClawHub 页面查看 Skill 信息

使用clawhub命令行下载https://clawhub.ai/16miku/image-downloader这个skill的最新版本

查看这个skill的功能

2. 单次调用

通过自然语言触发 skill

再次调用skill,发现新下载的图片不重复

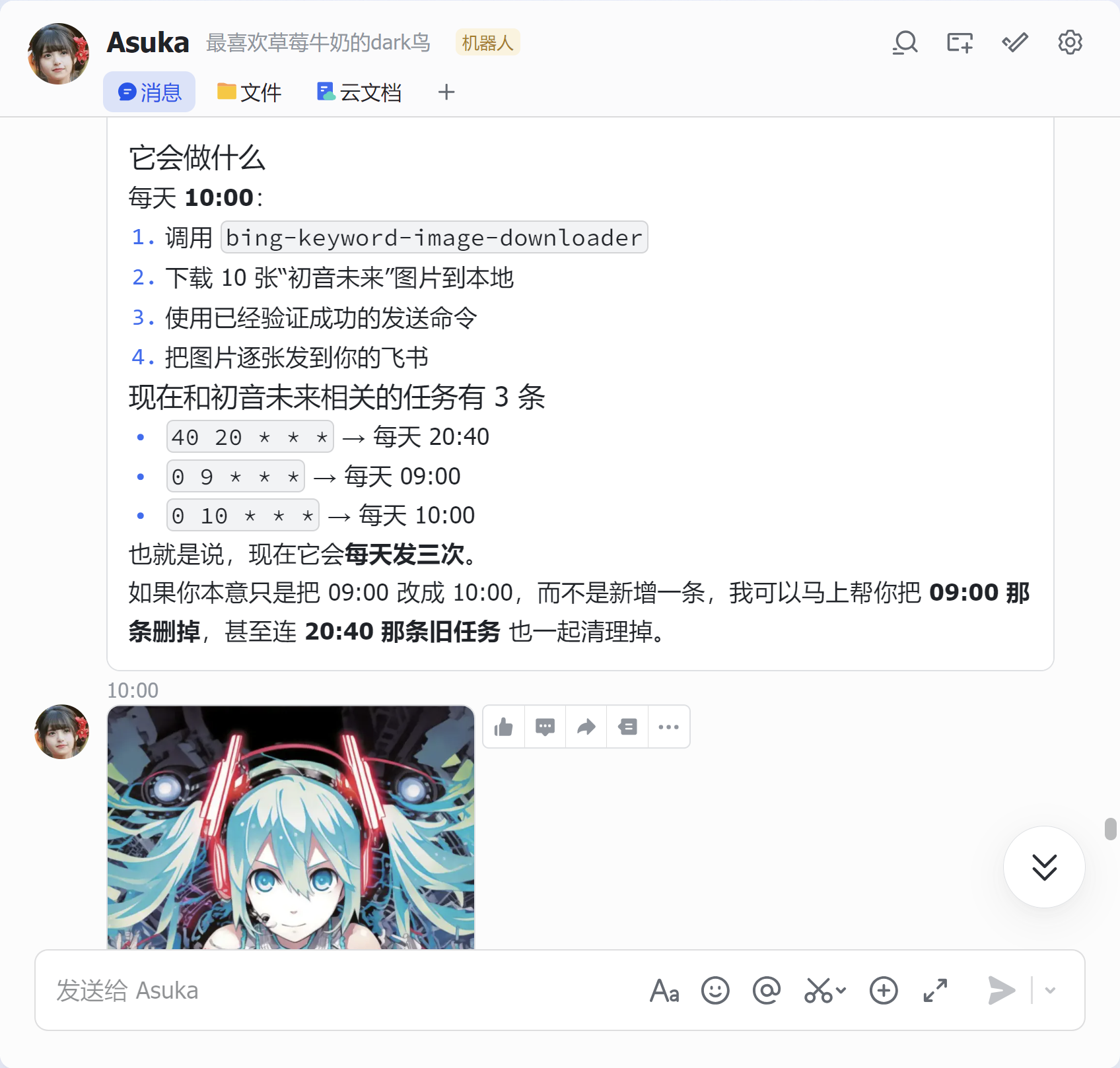

3. 定时执行

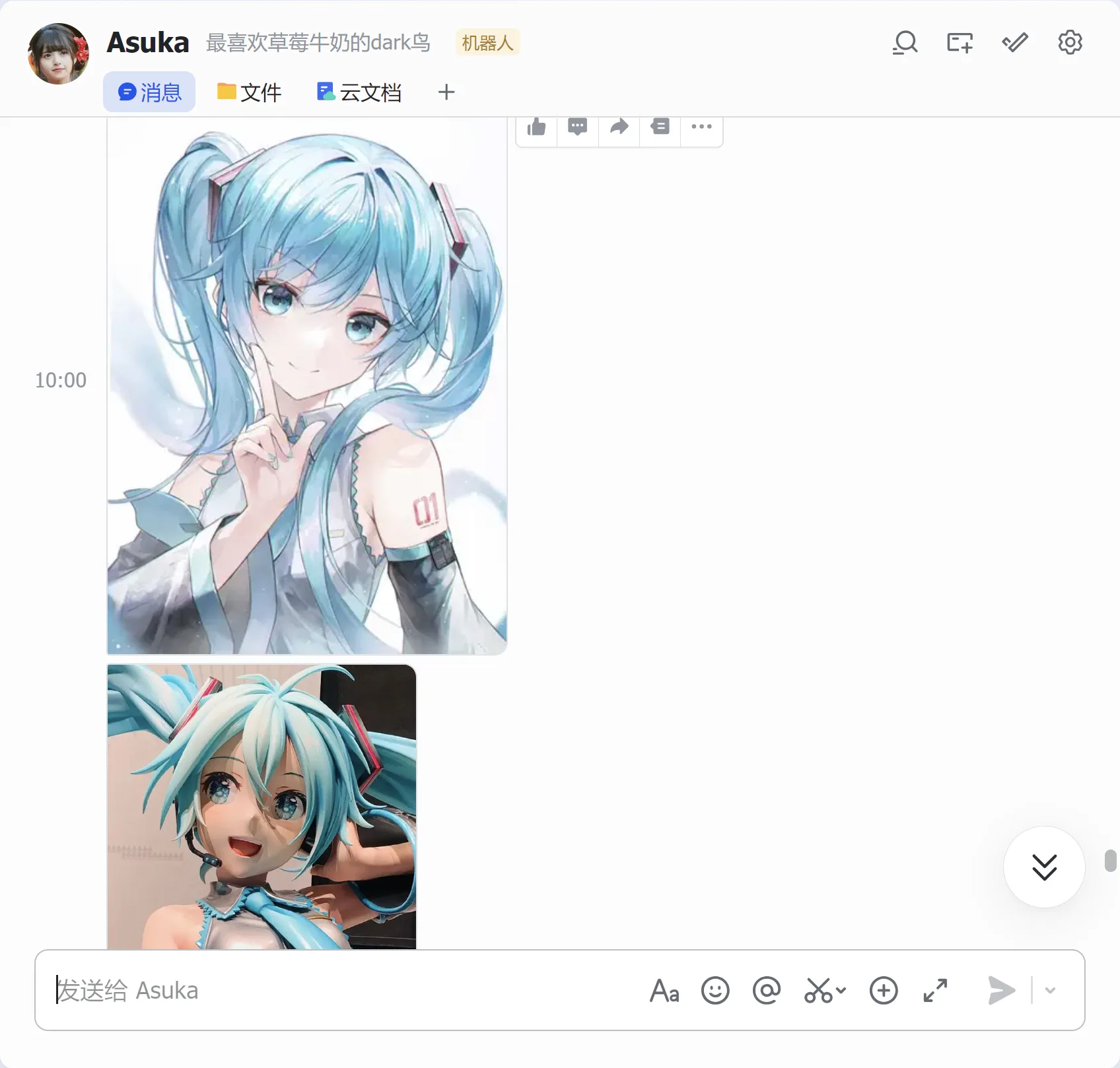

请你使用已验证成功的方案创建新的定时任务,在每天上午10点使用 image-downloader 这个skill,下载10张初音未来的照片,并将下载到本地的图片发送给我。创建每天下载并发送图片的定时任务

可以看到9:51创建的定时任务,在10:00时成功自动执行了。

八、我认为这个 Skill 最有价值的地方

我认为这个 skill 最有价值的地方,不是“能下图”,而是它把一个高频、重复、容易手工消耗时间的动作,整理成了可复用、可调用、可自动化的标准能力。

它非常适合下面这种工作流:

- 用户提出搜图需求

- Agent 调用 skill 下载图片

- 自动去重并记录历史

- 将结果直接发到聊天工具

- 后续继续按新的关键词迭代

这种能力一旦接入日常工作,就会从“临时脚本”升级成“长期稳定的生产工具”。

九、适合继续优化的方向

如果后续继续迭代,我认为可以考虑这些方向:

- 增加更多真实可用的图片来源

- 更细粒度的去重能力(例如感知哈希)

- 提供更强的失败重试策略

- 增加质量筛选或尺寸筛选

- 支持下载后的自动整理与压缩

- 支持更漂亮的结构化结果输出

当然,即使保持现在这个形态,它已经足够在很多实际场景里发挥价值了。

十、结语

如果你正在找一个能够按关键词批量下载图片、避免大量重复下载、输出清晰结果摘要、易于接入 Agent 和自动化流程的技能组件,那么image-downloader是一个值得尝试的项目。

它不花哨,但非常实用;不追求做成庞大平台,而是把“关键词批量搜图下载”这件事,做成了可以反复复用的基础能力。

对于做自动化、内容运营、Agent 工作流的人来说,这种小而稳的 skill,往往比大而全的工具更容易真正落地。